【2026年最新】Claude AI開発の落とし穴を防ぐ!情報漏洩対策と実務チェックリスト

blog

結論(時間のない方向け)

✅ IPA「情報セキュリティ10大脅威2026」にAIリスクが初選出

✅ Claude開発において、 APIキー・SSHキーの混入チェックと、機密チャット履歴の定期削除を今すぐルール化する

✅ Agentmemoryなど「便利な拡張ツール」は要注意 ─ セキュリティ確認前の業務利用は禁止を推奨

✅ DB設計にセキュリティ部分を網羅する・テスト計画書を作成する。

この記事の対象読者

・5〜30名規模で、専任のセキュリティ担当やPMがいないまま開発を外注・内製している中小企業の経営者・事業責任者

・AIツールを導入したが、セキュリティルールが整備されていないことに不安を感じているIT責任者・情報システム担当者

・Claude AIや生成AIを使ってシステム開発を進めているエンジニア・開発担当者

AI(Claude等)を使ったシステム開発のスピードは、以前と比べて劇的に向上しました。

要件定義からコード生成・レビューまで、AIが開発プロセス全体に関与する時代です。

しかしその裏で、「AIを使っているから安全」という誤解が、新たなセキュリティの穴を生んでいます。

2026年3月、IPA(情報処理推進機構)は「情報セキュリティ10大脅威2026」に「AIの利用をめぐるサイバーリスク」を初めて選出しました。

参照)IPA情報処理推進機構「情報セキュリティ10大脅威 2026」より

同月にはClaude Codeのソースコードが意図せずnpmレジストリに公開された事例も発生し、AI開発固有のリスクが業界全体で認識されるようになっています。

この記事では、Claude AIを活用したシステム開発において絶対に押さえるべきセキュリティ設定と実務レベルのチェックリストを、実際のプロジェクト経験をもとに解説します。

目次

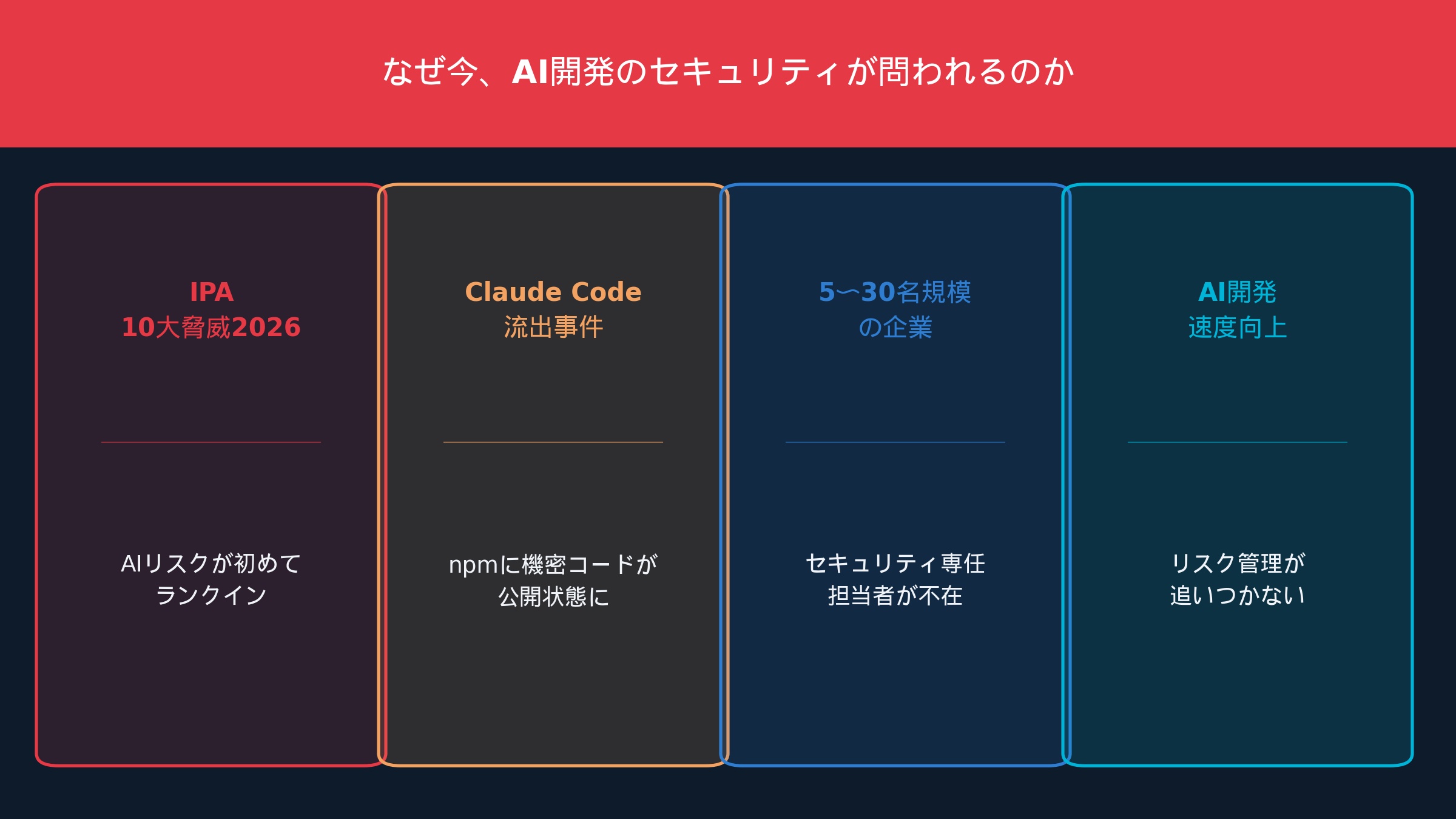

なぜ今、AI開発のセキュリティが問われるのか

IPA「10大脅威2026」にAIリスクが初選出

2026年版の「情報セキュリティ10大脅威」において、IPAは「AIの利用をめぐるサイバーリスク」を初めてランクインさせました。

これは、AIツールの業務利用が広がったことで、従来のセキュリティフレームワークでは対応しきれない新たなリスク類型が現実のものとなったことを意味します。

総務省も2026年3月27日付で「AIのセキュリティ確保のための技術的対策に係るガイドライン」を正式公表しました。

国レベルでのAIセキュリティ対応が本格化しています。

Claude Code流出事件が教えてくれたこと

2026年3月、Claude CodeのソースコードがnpmのパブリックレジストリにMap fileとして意図せず含まれ、一般公開可能な状態になっていたことが発覚しました。

Anthropicというトップクラスのセキュリティ意識を持つ企業でさえ、AIツールの開発・運用プロセスにセキュリティリスクが混入する——

この事実は、多くの開発者にとって重大な教訓です。

5〜30名規模の企業が特に危ない理由

大企業にはセキュリティ専任部門があります。

しかし30名以下の規模の中小企業や、あまりシステムに関連しない事業を展開する会社には、多くの場合、専任のセキュリティ担当者がいません。

専属でない担当者が兼任で開発や運用を回し、AIツールの導入もエンジニアの裁量に委ねられている——そういった現場こそ、以下で解説するリスクに無防備なまま晒されているケースが多いのです。

(しかしながら、大手企業でも最近は危険ですよね。情報漏洩ニュースの枚挙に暇がないですし、、、、)

Claudeを使う開発担当/運用担当が最初に守るべき「利用の作法」

機密情報の扱い方——コードを貼る前のチェック習慣

Claudeにコードを貼り付けて相談することは、開発効率を大幅に向上させます。

しかしその際、SSHキーやAPIキー、.envファイルの内容が誤って含まれていないかを必ず確認する習慣が不可欠です。

実務で起こりやすい事故のパターンは次のとおりです。

・「.env」ファイルごとコードをコピーして貼り付けてしまう

・Gitの差分を貼る際に、コミット履歴にシークレットが残っている

・インフラ設定ファイルにアクセスキーがハードコードされている

これらの対策として有効なのが「貼り付け前チェックリスト」の習慣化です。

コードをClaudeに渡す前に、シークレットスキャナー(例:git-secrets、trufflehog)でスキャンするフローを開発チームのルールとして明文化することを推奨します。また、作業中に一時的に利用したSSHキーや一時トークンは、作業完了後に必ず破棄・ローテーションしてください。

セッション(チャット履歴)の衛生管理

Claudeはチャットごとにセッションを管理しており、会話の文脈が引き継がれます。

この仕組みは便利である反面、機密情報を扱ったチャット履歴が残り続けることで「文脈漏洩」のリスクを生みます。

具体的には次のようなリスクが考えられます。

・機密性の高い設計情報を含むチャットが削除されず残り続ける

・チームでアカウントを共有している場合、別の担当者が履歴を参照できる

・ブラウザの同期機能によりデバイス間でチャット履歴が共有される

運用ルールとして、機密情報を扱ったセッションは作業完了後24時間以内に削除することをチームで合意することが重要です。

また、Claude for Work(Teamsプラン以上)を利用している場合は、管理者設定からトレーニングデータへの使用をオフにし、組織ポリシーでアクセス制御を設定してください。

「便利な拡張ツール」が生む新たな漏洩リスク——Agentmemory問題

2026年、GitHubで急速にトレンド入りした「Agentmemory」というツールをご存知でしょうか。Claude CodeとCodexに「無限メモリ」を後付けするOSSで、4,000以上のStarを獲得しています。

その機能は確かに魅力的に見えます。

・セッション間の文脈をAIが自動圧縮・継続

・CLAUDE.mdと比較してトークンを92%削減

・240セッション・1,000観測でも100%の検索精度

しかし業務利用には重大なリスクが伴います。

| リスク | 内容 |

| 外部サーバーへの送信 | 会話内容をクラウドサーバーに送信する仕組みのものが多く、APIキー・作業ログが漏洩するリスクがある |

| ローカル保存型も注意 | オープンソース=安全ではない。野良OSSを業務環境に入れる前にコード監査が必要 |

| ガバナンスの空白 | 誰が何のツールを入れているか、組織で把握できていないケースが多い |

セッション間の文脈継続は、CLAUDE.mdで代替できる範囲が広くあります。

セキュリティが確保されていないまま拡張ツールを業務環境に導入することは避け、公式機能の範囲内で運用することを強く推奨します。

安全なシステムを支えるDB設計の鉄則

セキュリティは「後付けでなんとかなる」ものではありません。

特にデータベース設計においては、設計段階から暗号化・トークン管理の方針を決め、実装に落とし込む必要があります。

AES-256-CBCによる暗号化の標準化

個人情報や機密ファイルを扱うシステムでは、保存データの暗号化が必須です。標準的な実装としてAES-256-CBC方式を採用し、以下の点を担保します。

- ファイルヘッダーの検証 ーストレージ上のファイルが暗号化済みであることをヘッダー確認で検証。復号なしでは内容が判読不能な状態を保つ ─ ノーコード・ローコードでWebアプリ・スマホアプリを構築

- 完全性の確認 ─ アップロードしたファイルを再ダウンロードしてハッシュ値を照合。暗号化・復号プロセスでデータが損なわれていないことを確認

IV(初期化ベクトル)の個別生成——全件ユニーク暗号化の実現

IV(初期化ベクトル)の個別生成——全件ユニーク暗号化の実現

同じ鍵で異なるファイルを暗号化する場合、IV(初期化ベクトル)をファイルごとに個別生成することが不可欠です。IVを使い回すと、暗号文パターンの解析により暗号の強度が著しく低下します。

DBのIV列が全件ユニークであることをテスト段階で検証し、実装品質を担保します。

CSPRNGによるトークン管理——ブルートフォース攻撃の遮断

URLトークンや認証トークンの生成には、CSPRNG(暗号論的擬似乱数生成器)を使用した32文字以上のランダム文字列を採用してください。

推測可能なトークンはブルートフォース攻撃の標的になります。

発行されるトークンがUNIQUE制約・32文字であることをDBレベルで担保し、テストで全件検証することがポイントです。

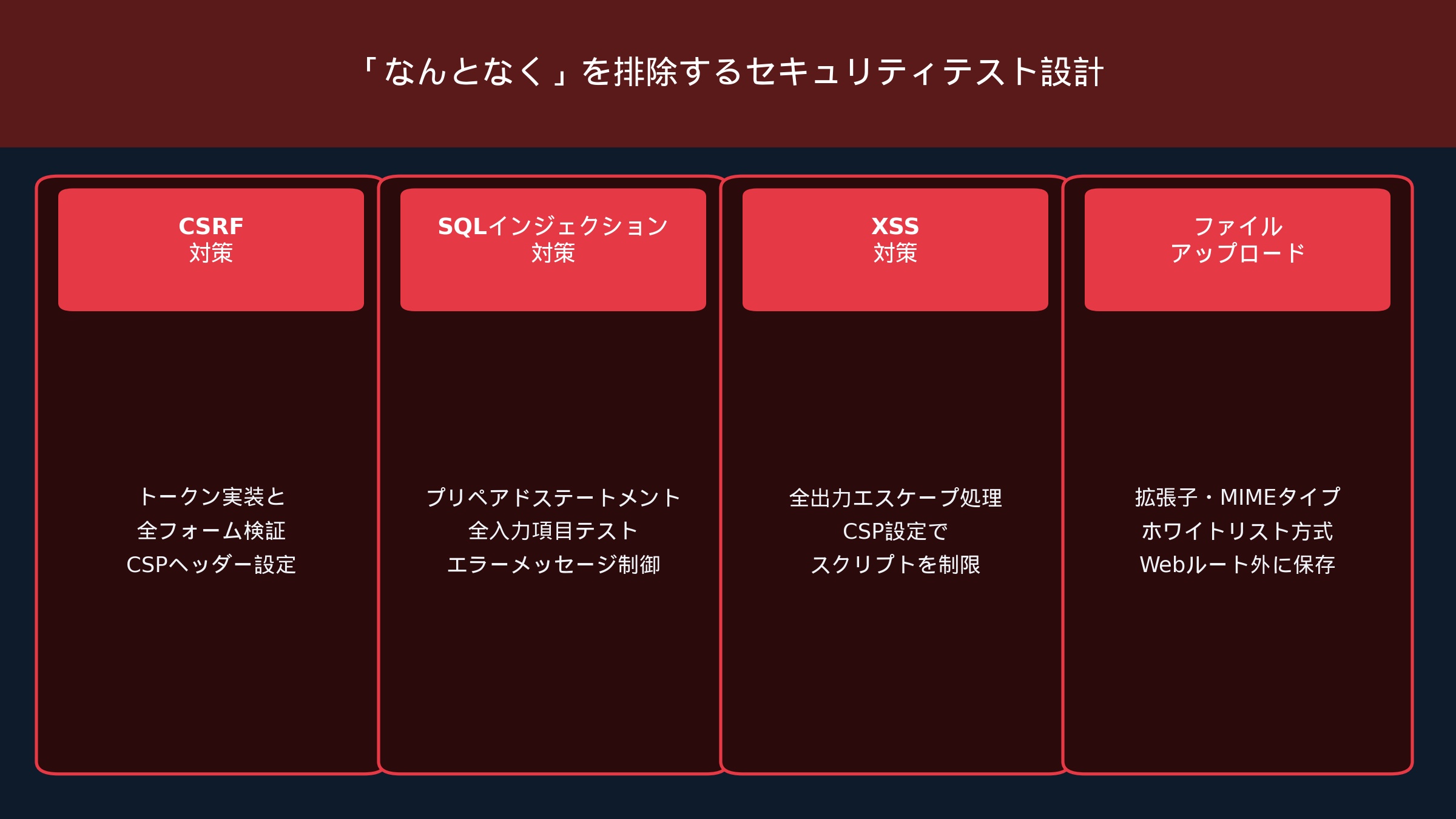

「なんとなく」を排除するセキュリティテスト設計

「テストした」という事実だけでは品質の担保になりません。

何を、どのような条件で、何をもって合格とするか——この定義がないセキュリティテストは、見落としを生み続けます。

CSRF・CSP対策の実装と検証

CSRF対策

管理画面や重要な操作を行うすべてのPOSTリクエストに_token(CSRFトークン)を必須化します。

トークンなしのPOSTに対して419エラーが返却されることをテストで確認します。

CSP(Content Security Policy)対策

外部スクリプトの読み込みをブロックするCSPヘッダーを設定し、意図しないスクリプト実行を防ぎます。script-src 'self'による制限で外部CDNからのリソース読み込みがブロックされることをブラウザコンソールで確認します。なお、自己ホスト済みライブラリについてはselfで許可し、CSP違反が発生しないことを同時に検証します。

アクセス制御とSQLインジェクション・XSS対策

アクセス制御

未ログイン状態での管理画面への直接アクセスが、302リダイレクトでログイン画面へ誘導されることを確認します。この「当たり前の動作」が実装されていないシステムは、今でも少なくありません。

XSS対策

フォームへの<script>タグ入力がテンプレートエンジンのHTMLエスケープ機能により無害化されることを検証します。ORM(例:Eloquentなど)を利用したDBアクセスでは、ユーザー入力がSQLに直接渡らない構造を確認します。

ファイルアップロードの厳格検証

ファイルアップロード機能は、適切な検証がなければシステムへの侵入口になりえます。

MIMEタイプ検証

.exeなどの実行ファイルが許可形式以外として拒否されることを確認

サイズ制限

例えば上限5MBを超えるファイルが、バリデーションエラーとして正しく拒否されることを確認

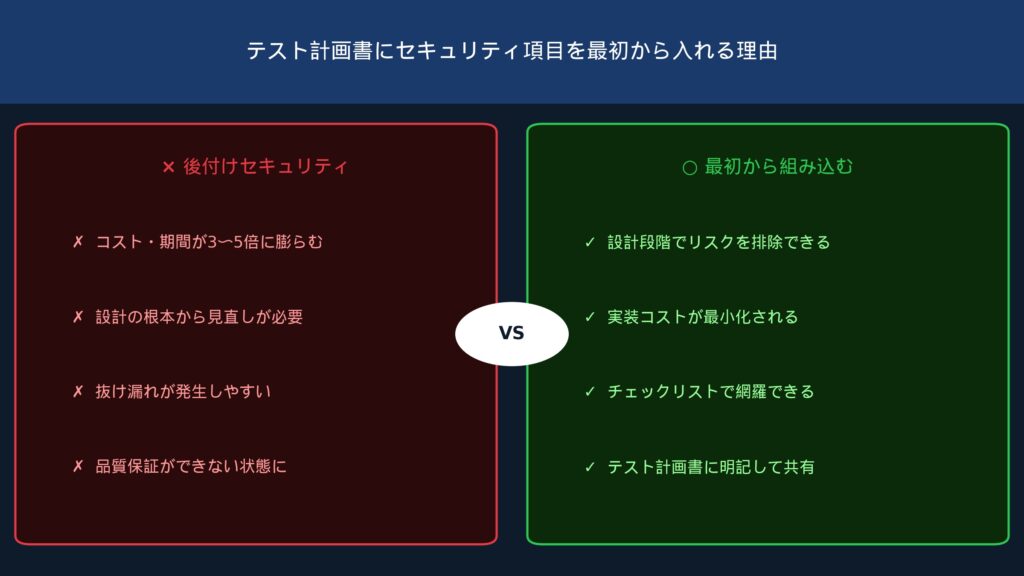

テスト計画書にセキュリティ項目を最初から入れる理由

「後付けセキュリティ」が漏れを生む構造的な理由

セキュリティ対策を後から追加しようとすると、必ず見落としが発生します。

理由は単純で、「何がどこにあるか」を把握しきれた状態でしか、網羅的なチェックはできないからです。

設計段階からセキュリティ要件を定義し、テスト計画書に検証項目として組み込むことで、納品物の品質を均一化できます。

検収基準を明文化することは、発注者・受注者の双方を守ることにもなります。

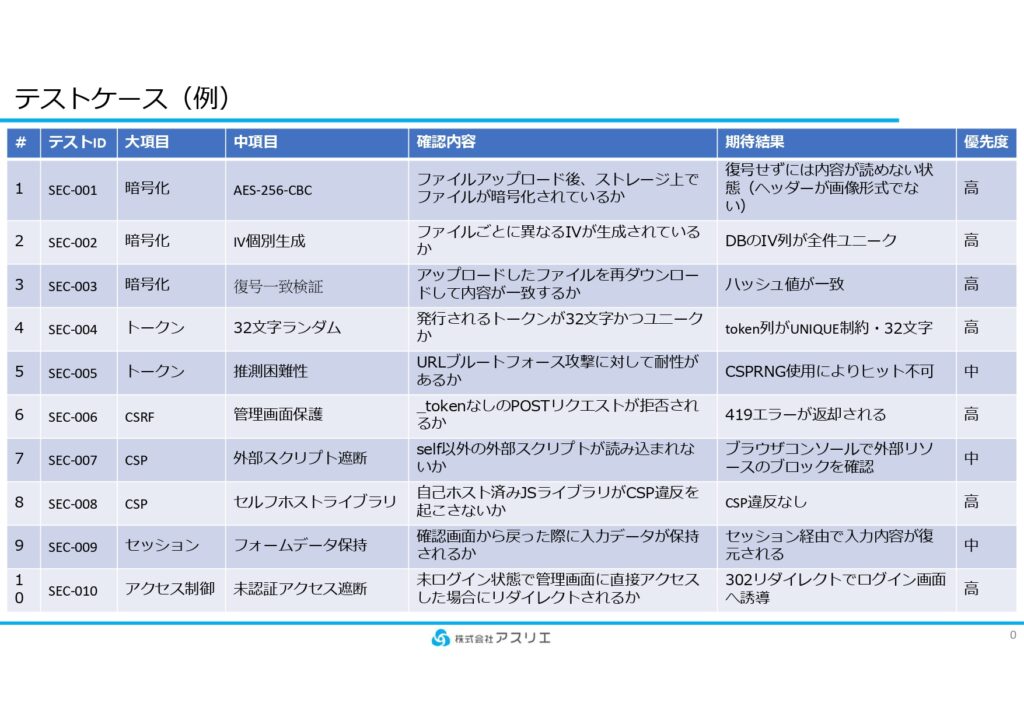

【実務ベース】セキュリティテスト項目一覧

以下は、当社が実際のプロジェクトで使用したテスト計画書をベースに、一般公開向けに再構成したセキュリティテスト項目例の一覧です。

これらは後から追加したものではなく、設計段階から要件として定義し、検収の判断基準として使用しています。

14項目すべてに合否判定をつけて納品することで、品質を均一に保つことができます。

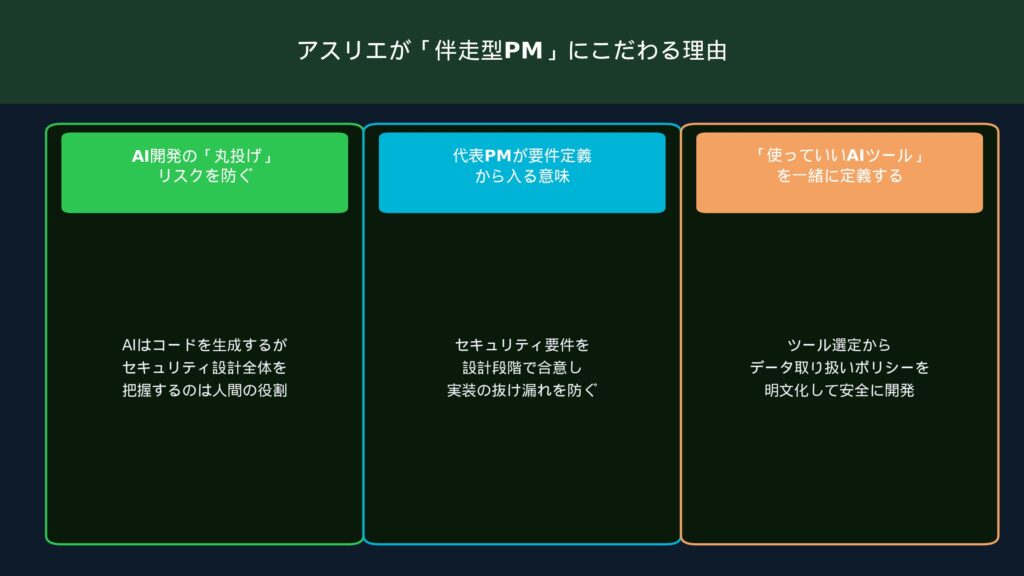

アスリエが「伴走型PM」にこだわる理由

AI開発の「丸投げ」が生む品質リスク

AIツールが発達した今、コードを書くこと自体は以前より格段に容易になりました。

しかしそれは同時に、「なんとなく動くシステム」が生まれやすくなったことも意味します。

AIが生成したコードの品質を判断できる人間がプロジェクトにいなければ、セキュリティの観点からも、保守性の観点からも、問題のある実装がそのままリリースされるリスクは高まります。

代表PMが要件定義から入る意味

アスリエでは、代表PMがクライアントとの要件定義の会議から参加します。

「どんなシステムを作るか」だけでなく、「どんな品質基準でテストし、どんな状態で納品するか」を最初から一緒に設計するためです。

この記事内で紹介したセキュリティーチェックテスト一覧のようなセキュリティチェック項目は、プロジェクトの開始時点でテスト計画書に組み込む必要があります。

「セキュリティは後で考える」ではなく、「最初から検収基準に入れておく」という設計思想です。

「使っていいAIツール」を一緒に定義する

前述のAgentmemoryのような拡張ツールが話題になるたびに、「うちも入れようか」という議論が社内で起きる企業は少なくありません。

アスリエでは、プロジェクト開始時に「使用が許可されているAIツール・拡張機能リスト」の明文化を伴走PMが一緒に整えます。

AI活用のメリットを最大化しながら、セキュリティリスクをコントロールする——

この両立こそが、現代の開発プロジェクトにおけるPMの役割です。

よくある質問(FAQ)

-1024x576.jpg)

A. 基本的なリスクの構造は同じです。どのAIツールを使う場合も、機密情報をプロンプトに含めないこと、チャット履歴の管理、拡張ツールの安全性確認が共通して必要です。ただしClaudeはAnthropicのSOC 2 Type 2認証を取得しており、Teams/Enterpriseプランでは会話データがトレーニングに使用されない設定が可能です。ツールの選定よりも「利用ルールの明文化」の方が、実務上のリスク低減に直結します。

A. 必ずしも安全とは言えません。AIが生成するコードは、SQLクエリでプレースホルダーを使わなかったり、ファイルアップロードのバリデーションが不十分だったりするケースがあります。AIの生成コードを使う場合は、セキュリティレビューを必ず実施することを推奨します。「AIが作ったから問題ないはず」は、最も危険な思い込みのひとつです。

A. 個人情報(氏名・住所・電話番号など)や機密情報を扱う場合は、システムの規模に関わらず暗号化が必要です。「社内しか使わないから大丈夫」という考え方は、不正アクセスや内部不正のリスクを見落としています。また個人情報保護法の観点からも、適切な安全管理措置が求められます。AES-256-CBCによる暗号化は実装コストも低く、後回しにする理由がありません。

A. 推奨しません。セキュリティを後付けにすると必ず見落としが生じます。特にDB設計やアクセス制御は、後から変更しようとすると大規模な修正が必要になります。テスト計画書にセキュリティーチェック一覧のような項目を最初から組み込み、設計段階から要件として定義することが、最もコスト効率の高い方法です。「動いてから直す」ではなく「最初から入れておく」が鉄則です。

A. まず「そのツールが会話内容をどこに保存・送信しているか」を確認することを優先してください。外部サーバーへの送信が確認された場合は、対応が過ぎるかもしれませんが、業務利用を即一時停止することを推奨します。ローカル保存型の場合も、コードの安全性が組織内で確認されるまでは使用を保留するのが望ましい判断です。代替として、CLAUDE.mdによる文脈管理を検討してください。

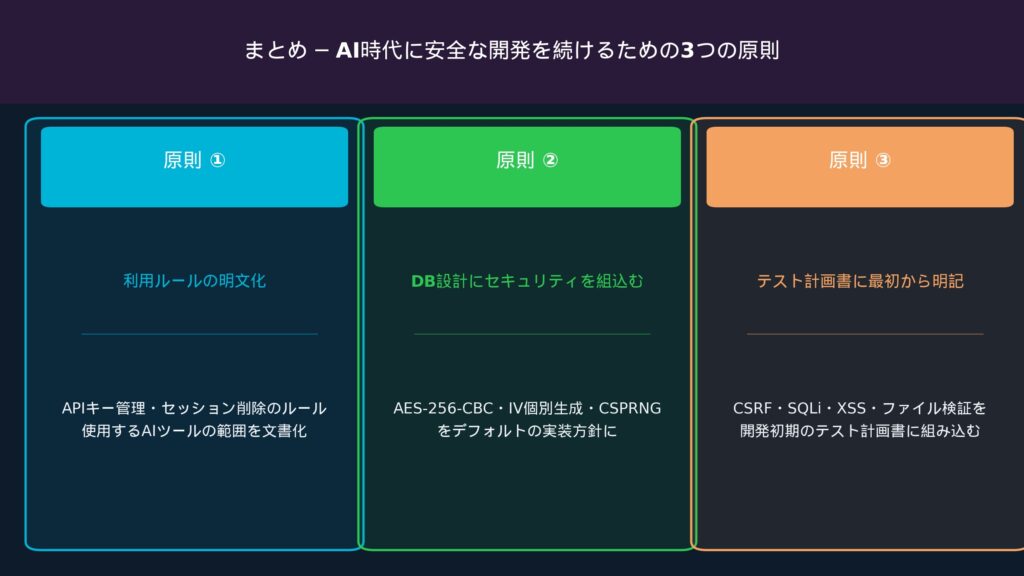

まとめ ─ AI時代に安全な開発を続けるための3つの原則

AI開発の高速化が進む中で、セキュリティを後回しにすることのコストは、以前より格段に高くなっています。

本記事で解説した内容を、3つの原則として整理します。

【原則1】Claude利用の「作法」を組織のルールとして明文化する

機密情報の取り扱い、セッション管理、拡張ツールの利用基準など、これらは個人判断ではなく、開発/運用チームのルールとして文書化してください。

【原則2】DB設計とテスト計画書にセキュリティを最初から組み込む

AES-256-CBCによる暗号化、IV個別生成、CSPRNGトークン、CSRF・XSS・SQLi対策、ファイル検証——これらは設計段階から要件として定義し、セキュリティーチェック一覧のような形でテスト計画書に落とし込むことで、見落としを防げます。

【原則3】PM不在の開発体制を見直し、「伴走者」を置く

AIは強力なツールですが、それを使いこなすための人間の設計力が不可欠です。

セキュリティの品質を担保するためには、要件定義からリリースまで一貫してプロジェクトを見る「伴走者」の存在が重要です。

この記事はアスリエの伴走PMによる実務経験をもとに執筆しています。

個別のセキュリティ設計についてはお気軽にご相談ください。

アスリエに依頼できること

- AI活用を前提とした新規システムの設計・開発

- 既存システムへのAI機能追加・業務自動化の組み込み

- AI活用システムの保守・運用サポート など